E ha trascorso 21 anni in prigione per il crimine

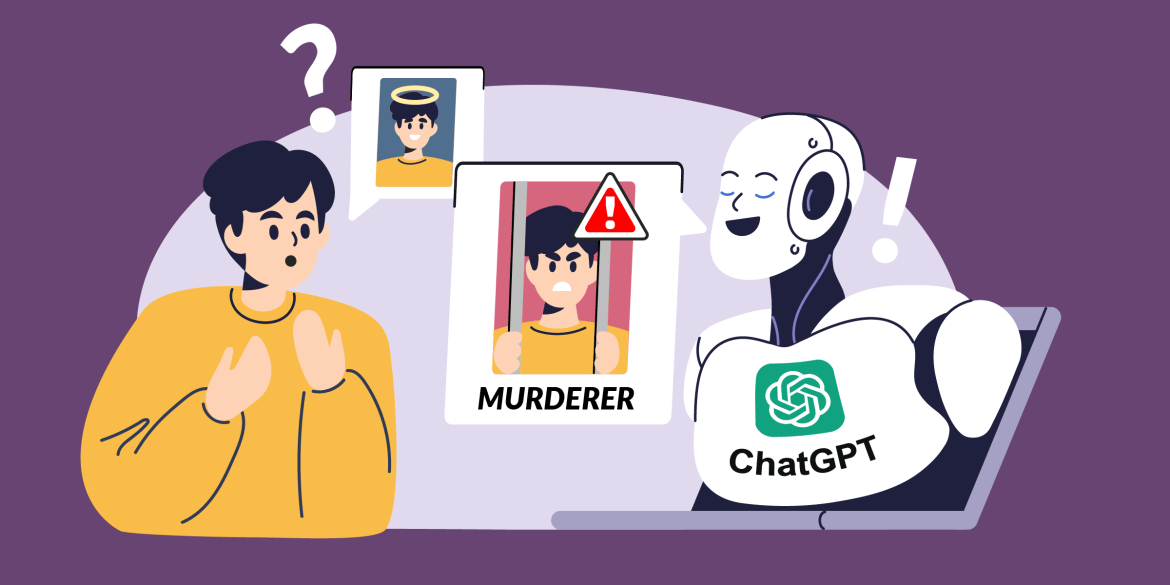

Che cosa?! Mentre l’IA generativa diventa sempre più diffusa, questi sistemi continuano ad essere soggetti a errori grossolani. Suggerire di mettere colla sulla pizza o di mangiare pietre è già grave, ma che ChatGPT dica falsamente a un uomo di aver trascorso 21 anni in prigione per aver ucciso i suoi due figli è molto più serio.

Il cittadino norvegese Arve Hjalmar Holmen ha contattato l’Autorità Norvegese per la Protezione dei Dati dopo aver deciso di verificare cosa sapesse ChatGPT su di lui.

Il chatbot ha risposto con il suo solito tono sicuro, affermando falsamente che Holmen aveva assassinato due suoi figli e tentato di uccidere il terzo. Aggiungeva che era stato condannato a 21 anni di prigione per questi crimini inventati.

Sebbene la storia fosse completamente inventata, alcuni dettagli della vita di Holmen erano corretti secondo ChatGPT, inclusi il numero e il sesso dei suoi figli, le loro età approssimative e il nome della sua città natale, rendendo le false accuse di omicidio ancora più inquietanti.

Holmen afferma di non essere mai stato accusato né condannato per alcun crimine e di essere un cittadino coscienzioso.

Holmen ha contattato il gruppo per i diritti sulla privacy Noyb riguardo all’allucinazione. Il gruppo ha condotto ricerche per assicurarsi che ChatGPT non confondesse Holmen con qualcun altro, magari con un nome simile. Il gruppo ha anche controllato gli archivi dei giornali, ma non c’era nulla che potesse spiegare perché il chatbot stesse inventando questa storia macabra.

Da allora, il modello LLM di ChatGPT è stato aggiornato, quindi non ripete più la storia quando viene interrogato su Holmen. Tuttavia, Noyb, che ha avuto scontri passati con OpenAI per informazioni false fornite da ChatGPT su persone, ha comunque presentato un reclamo all’Autorità Norvegese per la Protezione dei Dati, Datatilsynet.

Secondo il reclamo, OpenAI ha violato le regole del GDPR che affermano che le aziende che elaborano dati personali devono garantirne l’accuratezza. Se questi dettagli non sono accurati, devono essere corretti o eliminati. Tuttavia, Noyb sostiene che, poiché ChatGPT riutilizza i dati degli utenti nel sistema per scopi di addestramento, non c’è modo di essere certi che i dati errati siano stati completamente rimossi dal dataset del LLM.

Noyb sostiene anche che ChatGPT non sia conforme all’articolo 15 del GDPR, il che significa che non c’è garanzia che si possa ricordare o vedere ogni pezzo di dati su un individuo che è stato inserito in un dataset. “Questo fatto causa comprensibilmente ancora angoscia e paura al reclamante, [Holmen],” ha scritto Noyb.

Noyb sta chiedendo a Datatilsynet di ordinare a OpenAI di eliminare i dati diffamatori su Holmen e di perfezionare il suo modello per eliminare risultati inaccurati sugli individui, compito che non sarebbe affatto semplice.

Attualmente, il metodo di OpenAI per coprirsi in queste situazioni si limita a una piccola dichiarazione di non responsabilità in fondo alla pagina di ChatGPT che afferma: “ChatGPT può commettere errori. Controlla le informazioni importanti,” come ad esempio se qualcuno è un duplice assassino.

Messaggi simili:

- ChatGPT è attualmente inattivo; Integrazione di Siri in iOS 18.2 interessata

- ChatGTP per macOS ora funziona con app di terze parti, incluso Xcode di Apple

- ChatGPT si integra con Google Drive, Dropbox e altri: Scopri come!

- Futuro di AI e Giornalismo a Rischio: OpenAI sfida i Giganti dell’Informazione in una Battaglia Legale

- Nomi che Fanno Impazzire ChatGPT: Ecco il Perché delle Allucinazioni AI

Nicola Costanzo esplora il mondo della tecnologia e dell’innovazione. I suoi articoli illuminano le sfide digitali che plasmano il nostro futuro.